Правительство Австралии объявило о внезапных восьминедельных консультациях, целью которых будет выяснить, следует ли запретить какие-либо инструменты искусственного интеллекта «высокого риска».

Другие регионы, в том числе США, Европейский союз и Китай, также приняли меры для понимания и потенциального снижения рисков, связанных с быстрым развитием ИИ в последние месяцы.

1 июня министр промышленности и науки Эд Хусик объявил о выпуске двух документов — документа для обсуждения «Безопасный и ответственный ИИ в Австралии» и отчета Национального совета по науке и технологиям о генеративном ИИ.

Документы были опубликованы вместе с консультациями, которые продлятся до 26 июля.

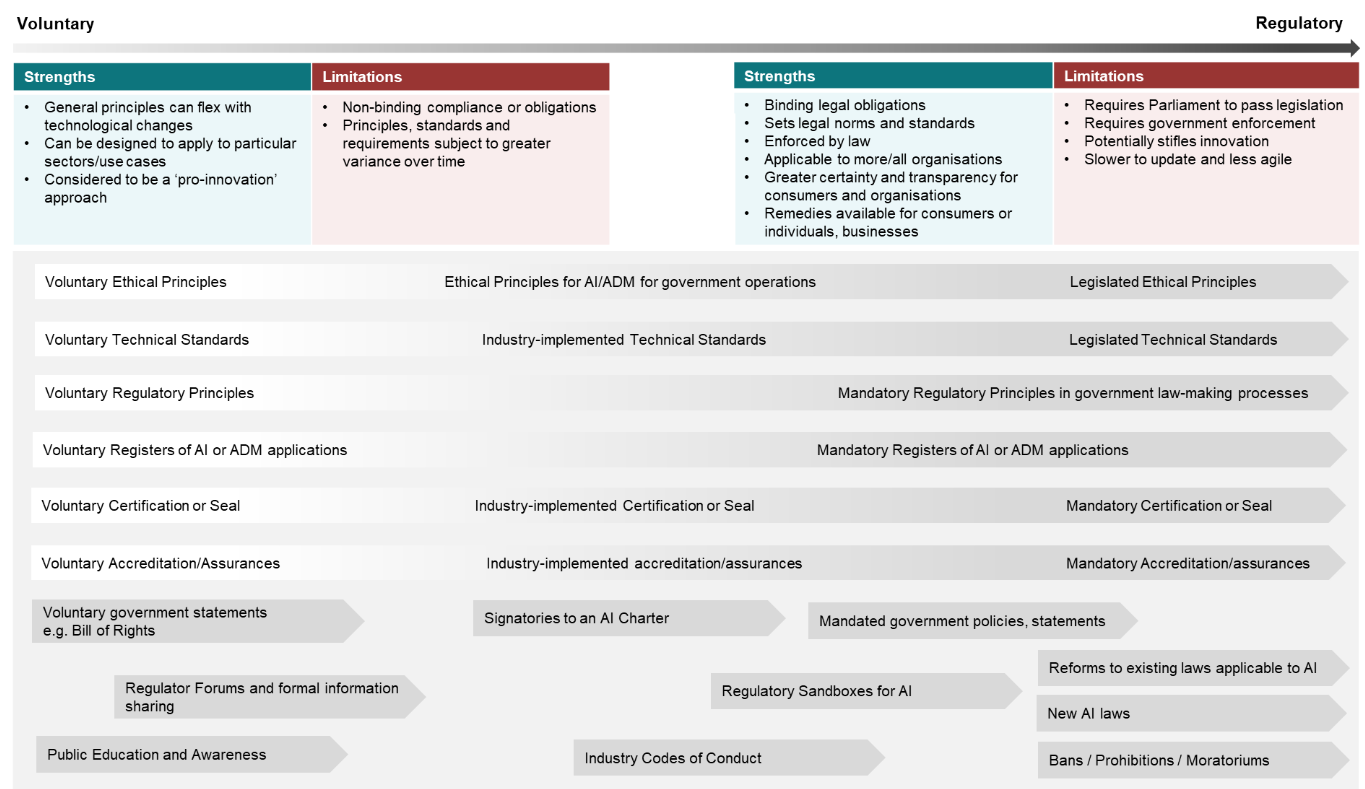

Правительство хочет получить отзывы о том, как поддержать «безопасное и ответственное использование ИИ», и обсуждает, следует ли ему использовать либо добровольные подходы, такие как этические рамки, если требуется конкретное регулирование, либо использовать сочетание обоих подходов.

Карта вариантов потенциального управления ИИ со спектром от «добровольного» до «нормативного». Источник: Департамент промышленности, науки и ресурсов.

Карта вариантов потенциального управления ИИ со спектром от «добровольного» до «нормативного». Источник: Департамент промышленности, науки и ресурсов.

Вопрос в консультации прямо спрашивает: «Должны ли быть полностью запрещены какие-либо приложения или технологии ИИ с высоким риском?» и какие критерии следует использовать для выявления таких инструментов ИИ, которые следует запретить.

Проект матрицы рисков для моделей ИИ был включен для обратной связи во всесторонний дискуссионный документ. Хотя только для того, чтобы привести примеры, он классифицировал ИИ в беспилотных автомобилях как «высокий риск», в то время как генеративный инструмент ИИ, используемый для таких целей, как создание медицинских карт пациентов, считался «средним риском».

#ИИ уже стал частью нашей жизни. По мере развития технологии нам необходимо обеспечить ее соответствие ожиданиям австралийцев в отношении ответственного использования. Примите участие в обсуждении @IndustryGovAu ниже. https://t.co/Gz11JCXlsG

— Главный научный сотрудник Австралии (@ScienceChiefAu) 1 июня 2023 г.

В документе подчеркивалось «положительное» использование ИИ в медицинской, инженерной и юридической отраслях, а также его «вредное» использование, такое как инструменты дипфейка, использование для создания фейковых новостей и случаи, когда боты ИИ поощряли членовредительство.

Предвзятость моделей ИИ и «галлюцинации» — бессмысленная или ложная информация, генерируемая ИИ, — также поднимались в качестве проблем.

Связанный: CSO Microsoft говорит, что ИИ поможет людям процветать, но все равно подписывает письмо судного дня

В дискуссионном документе утверждается, что внедрение ИИ в стране «относительно низкое», поскольку у него «низкий уровень общественного доверия». Он также указал на регулирование ИИ в других юрисдикциях и временный запрет Италии на ChatGPT.

Между тем, в отчете Национального совета по науке и технологиям говорится, что Австралия обладает некоторыми выгодными возможностями ИИ в робототехнике и компьютерном зрении, но ее «основные фундаментальные возможности в [large language models] и смежных областях является относительно слабым», и добавил:

«Концентрация генеративных ресурсов искусственного интеллекта в небольшом количестве крупных многонациональных и в основном американских технологических компаний открывает потенциал. [sic] риски для Австралии».

В отчете также обсуждалось глобальное регулирование ИИ, приводились примеры генеративных моделей ИИ и высказывалось мнение, что они «вероятно повлияют на все, от банковского дела и финансов до государственных услуг, образования и творческих отраслей».

AI Eye: 25 000 трейдеров делают ставки на выбор акций ChatGPT, ИИ отстой в бросках костей и многое другое

Источник: Сointеlеgrаph